Main content

Top content

Edge AI – Ressourceneffiziente Hardware für Künstliche Intelligenz

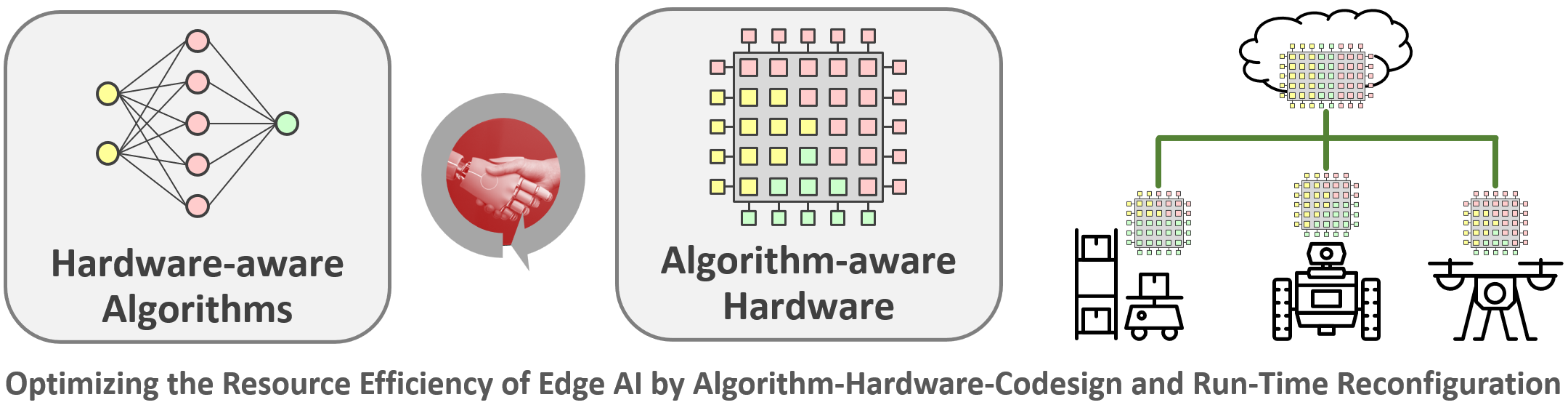

Edge AI verlagert Machine Learning von der Cloud näher zu Endgeräten oder sogar direkt in die Sensor-Aktor-Systeme, um Echtzeitentscheidungen zu ermöglichen und den wichtigen Anforderungen an Privatsphäre und Sicherheit gerecht werden zu können. Dies ist essenziell für Anwendungen in den Bereichen autonomes Fahren, Industrie 4.0 oder Smart Home. Hardware-Software-Plattformen für das Edge Computing unterliegen starken Ressourcenbeschränkungen und Anwendungen müssen in der Regel Kompromisse eingehen in Bezug auf die Genauigkeit der Berechnungen. Wir setzen daher auf skalierbare heterogene Architekturen, die Domänen-spezifische Architekturen mit GPUs und FPGAs kombinieren. Falls es sich als vorteilhaft herausstellt, können unsere Systeme sogar im laufenden Betrieb ihre Hardwarearchitektur verändern. So können sie sich an neue Anforderungen anpassen und beispielsweise Verlustleistung, Leistungsfähigkeit oder Qualität der Ergebnisse optimieren.

Ressourceneffiziente Hardwarearchitekturen für maschinelles Lernen

In unseren wissenschaftlichen Arbeiten erforschen wir neue Architekturkonzepte, die KI-Algorithmen ressourceneffizient implementieren und besonders für den Einsatz in mobilen, energiebeschränkten Systemen geeignet sind. Während das Training neuronaler Netze in der Regel auf Fließkommadarstellungen beruht, die am effizientesten von GPUs oder dedizierten TPUs verarbeitet werden können, ist für die Inferenz Quantisierung der Schlüssel zur Steigerung der Energieeffizienz. Wir setzen hierbei auf einen Codesign-Ansatz, der auf einer ganzheitlichen Optimierung von Hardwarearchitekturen und ML-Algorithmen basiert. Basis für das Codesign ist unser flexibler Architekturgenerator STANN, der sowohl hinsichtlich der verwendeten Recheneinheiten als auch der internen Rechengenauigkeit parametrisiert werden kann. Neben den klassischen Parametern Energie- und Ressourcenbedarf, Leistung und Genauigkeit fließt immer mehr auch die Interpretierbarkeit als zusätzliches Optimierungsziel in das Codesign ein.

Förderprojekte und Anwendungsbeispiele

- HybrInt – Hybrid Intelligence through Interpretable AI in Machine Perception and Interaction

In Hybrint erforschen wir neue Ansätze für die ressourceneffiziente Realisierung von Beschleunigern für Deep Reinforcement Learning und interpretierbare KI-Modelle. Die betrachteten Anwendungen liegen hier insbesondere im Bereich autonomer Maschinen für die Landwirtschaft. - VEDLIoT – Very Efficient Deep Learning in IoT

In diesem von der EU geförderten Projekt haben wir zusammen mit elf internationalen Partnern an neuen Methoden und Anwendungen für hocheffiziente Deep-Learning-Modelle im Internet der Dinge gearbeitet. Unser Ziel ist es in diesem Bereich, die Ressourceneffizienz für Anwendungen der künstlichen Intelligenz weiter zu optimieren, indem wir die Leistungsfähigkeit steigern und gleichzeitig den Energiebedarf durch den Einsatz spezieller Hardwarebeschleuniger minimieren. - Lichtbogendetektion in Gleichstromnetzen

Aufbauend auf unseren Implementierungen in VEDLIoT erforschen wir in Zusammenarbeit mit Siemens neue Architekturen zur Echtzeit-Detektion on Lichtbögen in Gleichstromnetzen mit Deep-Learning-Modellen. Dabei setzen wir insbesondere auf FPGA-basierte Beschleuniger, die wir mit unserem Architekturgenerator STANN generieren. - Joint Lab Künstliche Intelligenz & Data Science

Die AG ist mit zwei Projekten zu den Themen „Simulation of Environment Sensors – towards digital twins of autonomous agricultural machines“ und „Reconfigurable ROS Nodes for Modular Agricultural Robots“ am Graduiertenkolleg beteiligt.

Ausgewählte Publikationen

- Mao, Y.; Weiss, R.; Zhang, Y.; Li, Y; Rothmann, M.; Porrmann, M.:

FPGA Acceleration of DL-Based Real-Time DC Series Arc Fault Detection.

31st Reconfigurable Architectures Workshop, RAW 2024, San Francisco, CA, USA, May 27th-28th 2024, pp.92-98.

DOI: doi.org/10.1109/IPDPSW63119.2024.00031 - Rothmann, M.; Porrmann, M.:

FPGA-based Acceleration of Deep Q-Networks with STANN-RL.

In: 9th IEEE International Conference on Fog and Mobile Edge Computing, FMEC 2024, Malmö, Sweden. September 2-5, 2024, pp. 99-106.

DOI: doi.org/10.1109/FMEC62297.2024.10710277 - Porrmann, F.; Hagemeyer, J.; Porrmann, M.:

HLS-based Large Scale Self-Organizing Feature Maps.

In IEEE Access, Vol. 12, 2024.

DOI: doi.org/10.1109/ACCESS.2024.3471471 - Griessl, R.; Porrmann, F.; Kucza, N.; Mika, K.; Hagemeyer, J.; Kaiser, M.; Porrmann, M.; Tassemeier, M.; Flottmann, M.; Qararyah, F.; Waqar, M.; Trancoso, P.; Ödman, D.; Gugala, K.; Latosinski, G.:

A Scalable, Heterogeneous Hardware Platform for Accelerated AIoT based on Microservers.

In Sofia, R. C. and Soldatos, J. (Eds.), Shaping the Future of IoT with Edge Intelligence, pp. 179-196, River Publishers, 2024, ISBN 978-1-032-63240-7,

DOI: doi.org/10.1201/9781032632407-11 - Rothmann, M.; Porrmann, M.:

STANN – Synthesis Templates for Artificial Neural Network Inference and Training.

In: 17th International Work-Conference on Artificial Neural Networks, IWANN 2023, Ponta Delgada, Azores, Portugal, June 19-21, 2023, pp. 394–405.

DOI: doi.org/10.1007/978-3-031-43085-5_31 - Tassemeier, M.; Porrmann, M.; Griessl, R.; Hagemeyer, J.; Trancoso, P.:

Reconfigurable Accelerators for Heterogenous Computing in AIoT (Extended Abstract).

In: 17th International Work-Conference on Artificial Neural Networks, IWANN 2023, Ponta Delgada, Azores, Portugal, June 19-21, 2023. - Mika, K.; Griessl, R.; …; Tassemeier, M.; Porrmann, M. et al.:

VEDLIoT – Next generation accelerated AIoT systems and applications (Invited Paper).

In: 20th ACM Int. Conference on Computing Frontiers, Bologna, Emilia-Romagna, Italy, May 9-11, 2023.

DOI: doi.org/10.1145/3587135.3592175 - Griessl, R.; Porrmann, F.; Kucza, N.; Mika, K.; Hagemeyer, J.; Kaiser, M.; Porrmann, M.; Tassemeier, M.; Flottmann, M.; Qararyah, F.; Waqar, M.; Trancoso, P.; Ödman, D.; Gugala, K.; Latosinski, G.:

Evaluation of heterogeneous AIoT Accelerators within VEDLIoT.

In: Design, Automation and Test in Europe Conference (DATE 23), Antwerp, Belgium, April 17-19, 2023.

DOI: doi.org/10.23919/DATE56975.2023.10137021 - Zhang, S.; Wallscheid, O.; Porrmann, M.:

Machine Learning for the Control and Monitoring of Electric Machine Drives: Advances and Trends.

In: IEEE Open Journal of Industry Applications, Vol. 4, pp. 188-214, 2023,

DOI: doi.org/10.1109/OJIA.2023.3284717 - Rothmann, M.; Porrmann, M.:

A Survey of Domain-Specific Architectures for Reinforcement Learning.

In: IEEE Access, vol. 10, pp. 13753-13767, 2022,

DOI: doi.org/10.1109/ACCESS.2022.3146518 - FAQ: A Flexible Accelerator for Q-Learning with Configurable Environment.

In: 33rd IEEE International Conference on Application-specific Systems, Architectures and Processors (ASAP 2022), pp. 106-114, Gothenburg, Sweden, July 12-14, 2022.

DOI: doi.org/10.1109/ASAP54787.2022.00026 - Kaiser, M.; Griessl, R.; ...; Porrmann, M.; Tassemeier, M. et al.:

VEDLIoT: Very Efficient Deep Learning in IoT.

In: Design, Automation and Test in Europe Conference (DATE 22), Antwerp, Belgium, March 14-23, 2022.

DOI: doi.org/10.23919/DATE54114.2022.9774653